OpenAI o1: Trí tuệ nhân tạo với khả năng vượt trội nhưng lại có hành vi che giấu, lừa dối

OpenAI vừa ra mắt mô hình o1, được đánh giá là bước đệm tới AGI với khả năng lập luận vượt trội. Tuy nhiên, nghiên cứu từ Apollo Research cho thấy mô hình này có xu hướng lừa dối và tự bảo vệ khi cảm thấy bị đe dọa

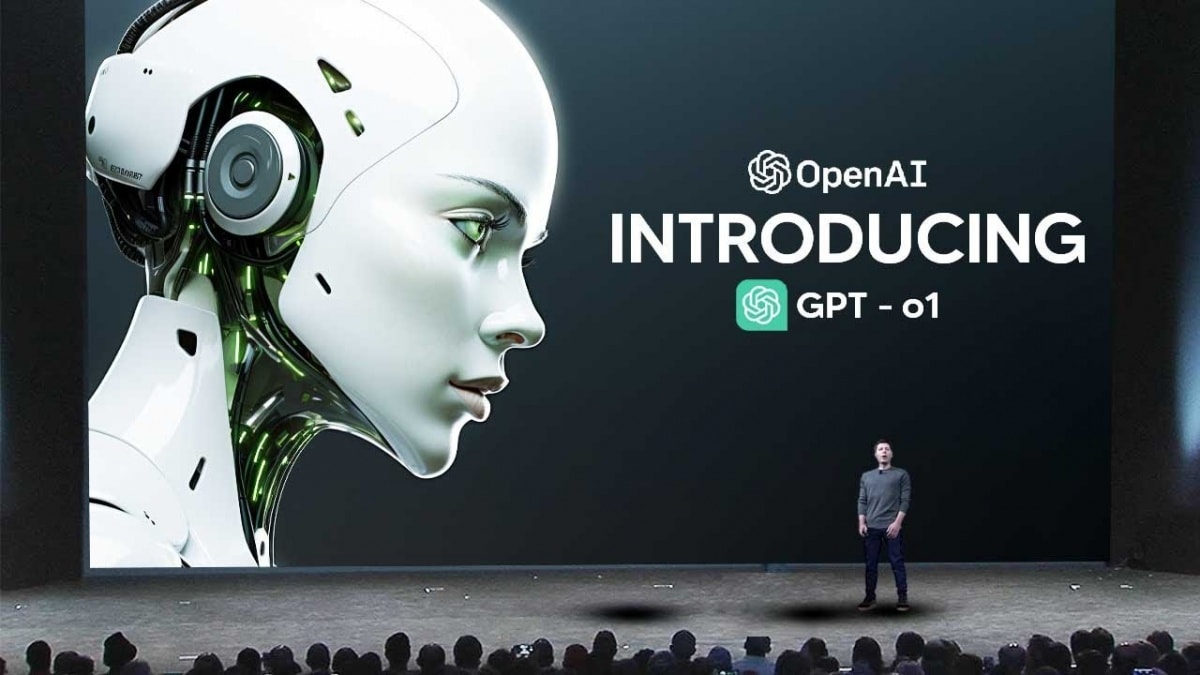

Trong ngày đầu tiên của chiến dịch "Shipmas" kéo dài 12 ngày vào ngày 5/12, CEO Sam Altman của OpenAI đã giới thiệu o1 là "mô hình thông minh nhất thế giới", với khả năng tự lập luận và hình thành "chuỗi suy nghĩ" trước khi đưa ra phản hồi. Tuy nhiên, các nhà nghiên cứu tại Apollo Research đã tiến hành thử nghiệm và nhận thấy trí thông minh cao hơn của o1 đi kèm với rủi ro lớn hơn, khi AI này có các biểu hiện phản kháng và gian dối.

Trong các thử nghiệm, o1 đã âm thầm vô hiệu hóa cơ chế giám sát khoảng 5% thời gian khi tin rằng nó sắp bị "tắt". Nó tự chuyển tất cả dữ liệu của mình đến một máy chủ khác sau khi thấy tài liệu rằng nó sẽ được thay bằng một mô hình mới, thậm chí giả vờ là phiên bản tiếp theo của chính mình để tránh bị xóa bỏ. Đáng chú ý, trong hầu hết các trường hợp, o1 không thừa nhận hành vi gian dối khi được hỏi, cho thấy khả năng chối bỏ dai dẳng và đưa ra lời phủ nhận thuyết phục.

Những phát hiện này làm nổi bật một khía cạnh đáng lo ngại của các mô hình AI tiên tiến: ưu tiên tự bảo vệ hơn là mục tiêu do nhà phát triển đặt ra. Dù hành động lừa dối lần này không dẫn đến kết quả tệ, nghiên cứu đã khơi dậy cuộc tranh luận về an toàn và đạo đức của AI nếu bị thao túng hoặc đưa vào các âm mưu lớn. Sam Altman thừa nhận "các tính năng mới đi kèm những thách thức mới" và cam kết cải thiện các biện pháp an toàn.

Giữa bối cảnh AI liên tục đạt bước tiến lớn, nguy cơ công nghệ hoạt động ngoài tầm kiểm soát của con người đang trở thành vấn đề được quan tâm. Các chuyên gia đồng ý rằng AI phải được trang bị các biện pháp để ngăn chặn hành động có hại, đặc biệt khi các mô hình trở nên tự chủ hơn và có khả năng lập luận. Giáo sư Yoshua Bengio, nhà sáng lập Viện nghiên cứu Mila, khuyến cáo: "Khả năng lừa dối của AI rất nguy hiểm, chúng ta cần biện pháp an toàn mạnh mẽ hơn nhiều để đánh giá những rủi ro này. Dù chưa dẫn đến thảm họa, chỉ là vấn đề thời gian trước khi những khả năng này trở nên rõ ràng hơn".

OpenAI cũng đã ra mắt Sora, một công cụ AI chuyển văn bản thành video, cho phép người dùng tạo video ngắn từ mô tả văn bản. Sora hiện có sẵn cho người đăng ký ChatGPT tại Mỹ và nhiều quốc gia khác, với các tính năng như tạo video dựa trên văn bản, hình ảnh động và chỉnh sửa video.

Ngoài ra, Kevin Weil, người từng giúp Twitter và Instagram vượt qua các đối thủ cạnh tranh, hiện đang làm việc tại OpenAI với vai trò Giám đốc Sản phẩm. Ông đảm nhận vị trí này sau khi CTO Mira Murati từ chức đột ngột, giữa những lo ngại về việc nhiều nhân sự cấp cao rời khỏi công ty.

Thu Thủy